昆仑万维天工通用大模型推理能力大幅超过GPT-3.5和LLaMA2

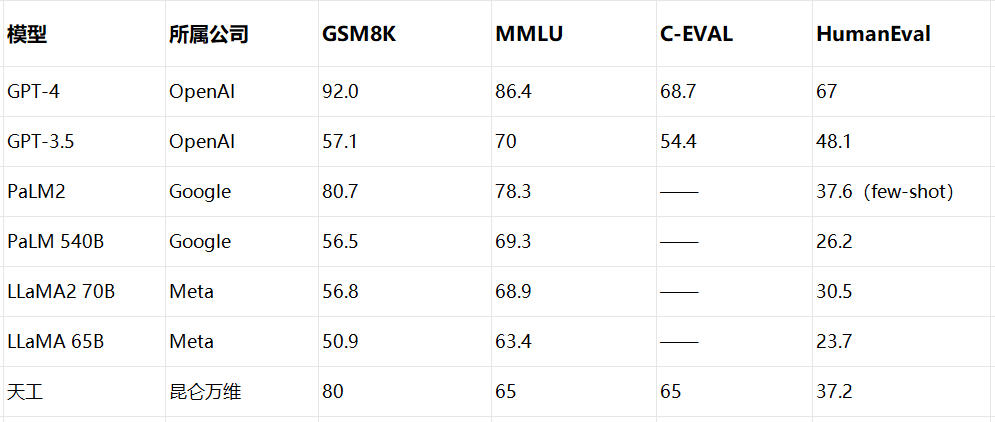

一直以来,昆仑万维完全自研的天工大模型(以下简称“天工”)作为通用基座大模型,始终追求技术创新,致力于突破基座技术壁垒。9月16日,在权威推理榜单Benchmark GSM8K 测试中,天工以80%的正确率脱颖而出,大幅领先GPT-3.5(57.1%)和LLaMA2-70B(56.8%),这标志着天工的推理能力达到全球领先,接近GPT-4。

天工大模型不仅在推理性能上有着强大的竞争力,在MMLU、C-EVAL、HumanEval等三项数据集测试中也同样表现出色。在MMLU数据集测试中,天工以65%准确率超越了LLaMA-65B的63.4%;在C-EVAL数据集测试中,天工以65%准确率超越了GPT3.5的54.4%。在HumanEval数据集测试中,天工以37.2%的准确率超过了PaLM-540B(26.2%)、LLaMA-65B(23.7%)、LLaMa2 -70B(30.5%)。

根据公开测试数据搜集整理

推理能力对于判断一个基座大模型是否“聪明”至关重要。在GSM8K、MMLU、C-EVAL、HumanEval四项数据集测试中,天工大模型均获得较高的正确率,表明天工大模型的通用能力很强,核心性能均达到了国际领先水准。

01 天工多项数据集测试均表现优秀

在上述几个数据集里,GSM8K英文数据集测试是目前全球公认的评判基座大模型推理能力的权威标准。

GSM8K包含8500个高质量的数学问题。这些问题被分为7500个训练问题和1000个测试问题,一般需要2到8个步骤来解决。这些问题的解决主要涉及算术运算。GSM8K数据集的目的是用来测试推理多步数学问题的能力。研究人员通常使用GSM8K来评估大型语言模型在解决英文数学问题时的性能表现。

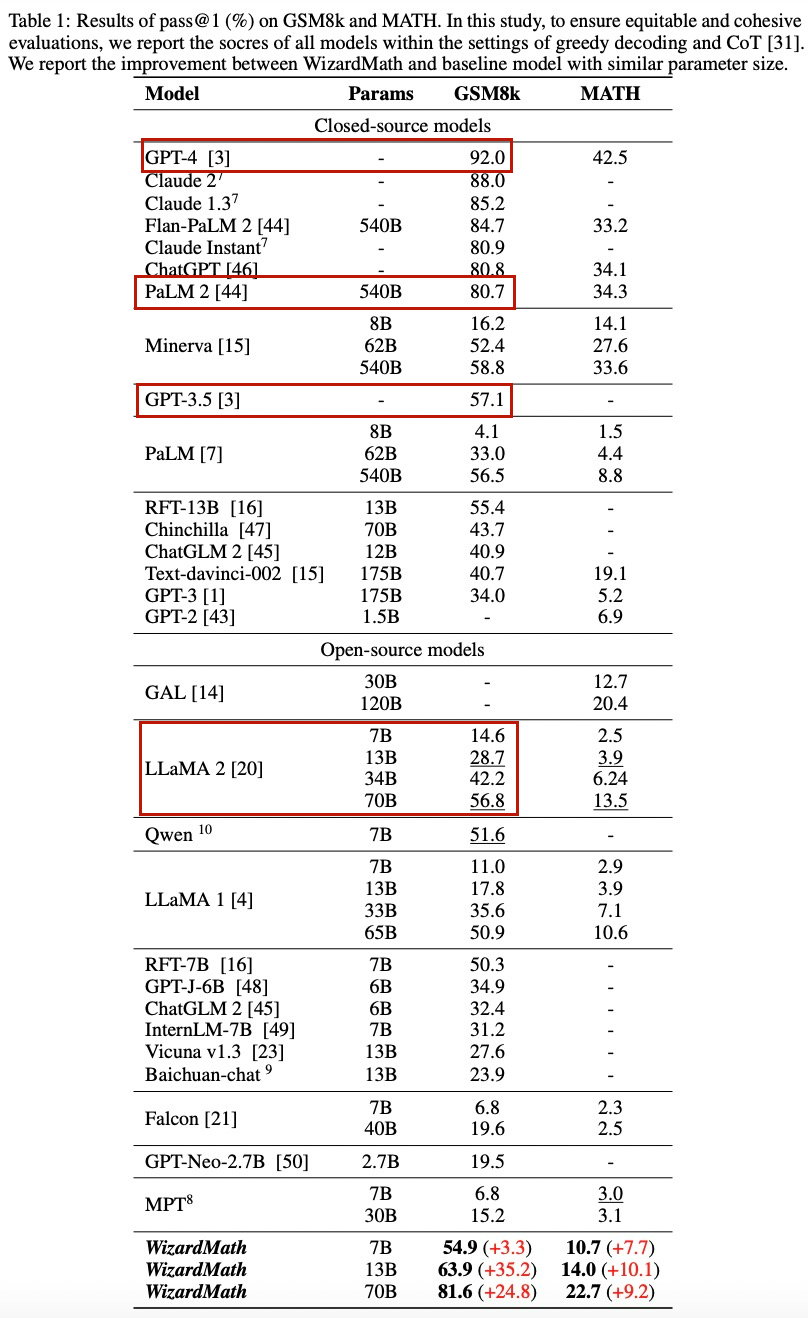

目前国内外多个大模型都进行了GSM8K的测试。例如,微软与中国科学院在2023年8月联合发布了一项关于WizardMath的研究结果,该研究主要在 GSM8K和MATH这两个常见的数学基准上测试了多个模型的性能,涵盖了大量主流模型,参与测试的模型包括:

闭源模型:OpenAI 的 GPT-3、GPT-3.5、ChatGPT、GPT-4,谷歌的 PaLM 2、PaLM、 Minerva,Anthropic 的 Claude Instant、Claude 1.3、Claude 2, DeepMind 的 Chinchilla;

开源模型:Llama 1、Llama 2、GAL、GPT-J、GPT-Neo、Vicuna、MPT、Falcon、Baichuan、ChatGLM、Qwen 和 RFT

在这项研究中,最后这些模型的得分如下:

研究论文地址 https://github.com/nlpxucan/WizardLM/blob/main/WizardMath/WizardMath_Paper.pdf

据论文,Google PaLM 的正确率不超过56.5%,LLaMA2不同参数规模的正确率最高不超过56.8%,GPT-3.5 的正确率为57.1%,GPT-4的正确率为92%。

而天工的GSM8K测试正确率为80%,这代表天工大模型整个基座的推理能力在同等规模大模型中出类拔萃,大幅超过GPT-3.5和LLaMA2-70B,达到全球领先水平。在上述研究中,WizardMath作为目前数学垂域最好的开源模型,GSM8K正确率仅比天工高1.6%。

除了GSM8K外,天工参与评测的其他几个数据集在业内也相当权威。

MMLU由加州大学伯克利分校等知名高校共同打造,集合了科学、工程、数学、人文、社会科学等领域的57个科目,主要目标是对模型的英文跨学科专业能力进行深入测试;C-EVAL评测基准由上海交通大学、清华大学以及爱丁堡大学联合创建,是一个面向中文语言模型的综合考试评测集,覆盖了52个来自不同行业领域的学科;HumanEval是OpenAI为了评估Codex模型的有效性而创建的数据集,通过HumanEval研究人员可以对Codex模型进行评估,并了解其在代码生成方面的准确性和效果。

这几个都是业界公认的用来评估模型在语言理解、推理、算法和数学等方面核心性能的重要数据集,天工的得分都相对较高。

除了英文数据集,天工大模型在小米的中文开源数据集CMATH测试中也表现良好。

CMATH数据集包括1700个小学水平的数学应用题和详细的注释,旨在提供一个基准工具,评估当前流行的大模型的数学能力对应小学数学哪一年级的水平,在这份测试集中天工大模型的平均准确率为76.4%高于ChatGPT的平均准确率74.8%,并全面领先其他主流大模型,这充分表明天工大模型在中文场景的数理能力表现也十分优秀。

天工大模型之所以表现如此优秀,除了积累了大量的高质量语料外,对多数据源的高效融合策略,不同语言间的能力迁移以及如何更好的激发基座逻辑推理能力有着深刻的见解。

02 天工的推理能力超过GPT-3.5

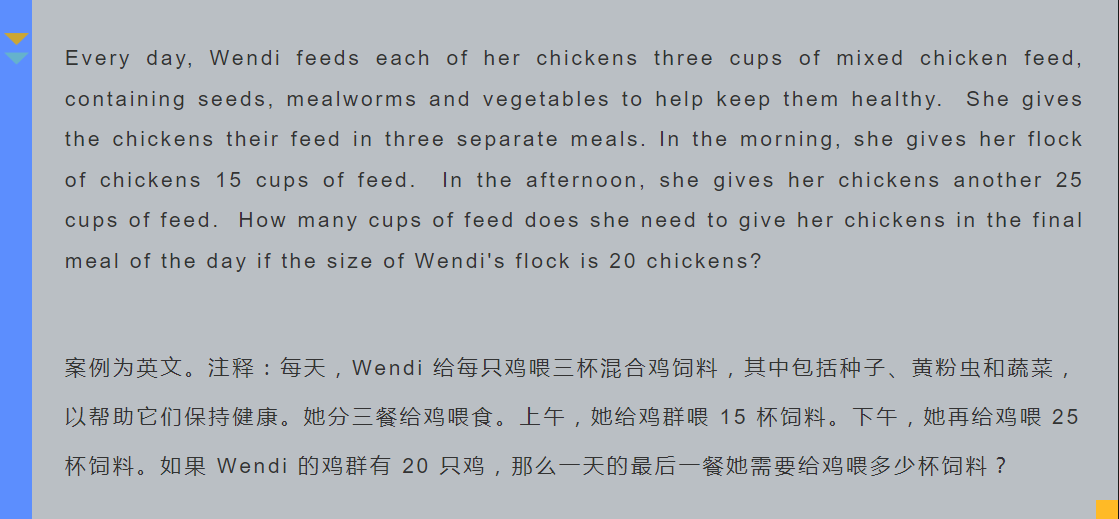

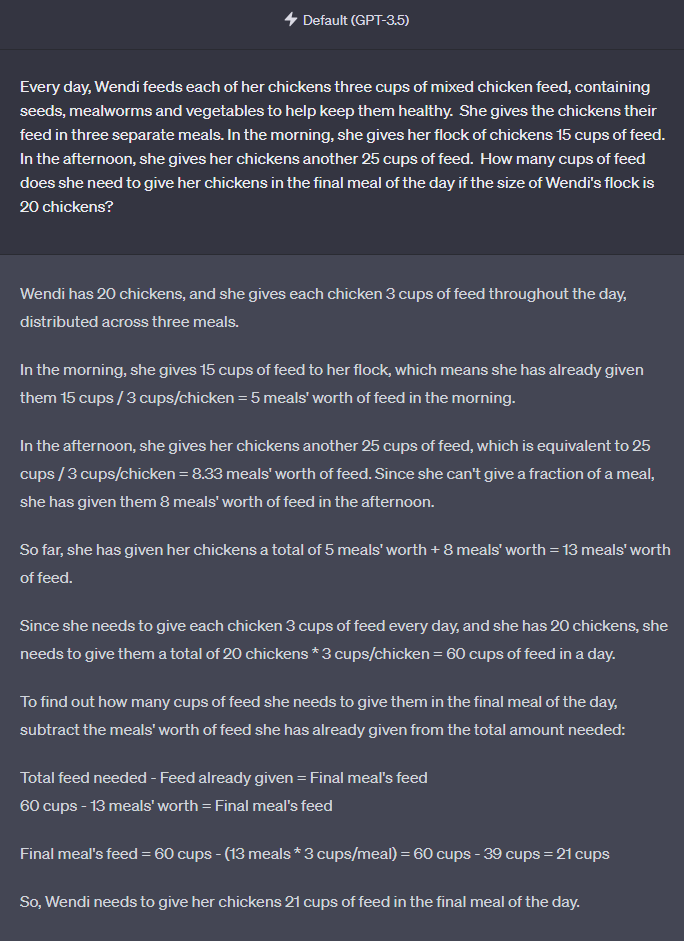

天工的推理能力取得全球领先的水平,超过了GPT-3.5和LLaMA2,那让我们来看看天工和GPT-3.5在GSM8K测试中的具体表现。

01

天工给出了这样的思路:

最后天工大模型给出的答案是:Wendi 需要在一天的最后一餐中给鸡喂 20 杯饲料,以确保它们一天都吃饱。

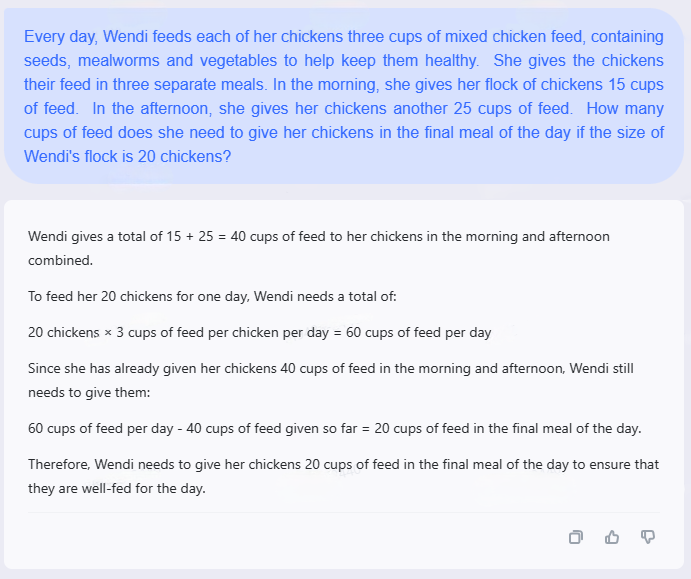

GPT-3.5 给出了这样的解题思路:

GPT-3.5给出的答案为:Wendi 需要在一天的最后一餐中给鸡喂 21 杯饲料。

显然,GPT-3.5给出了错误的答案。

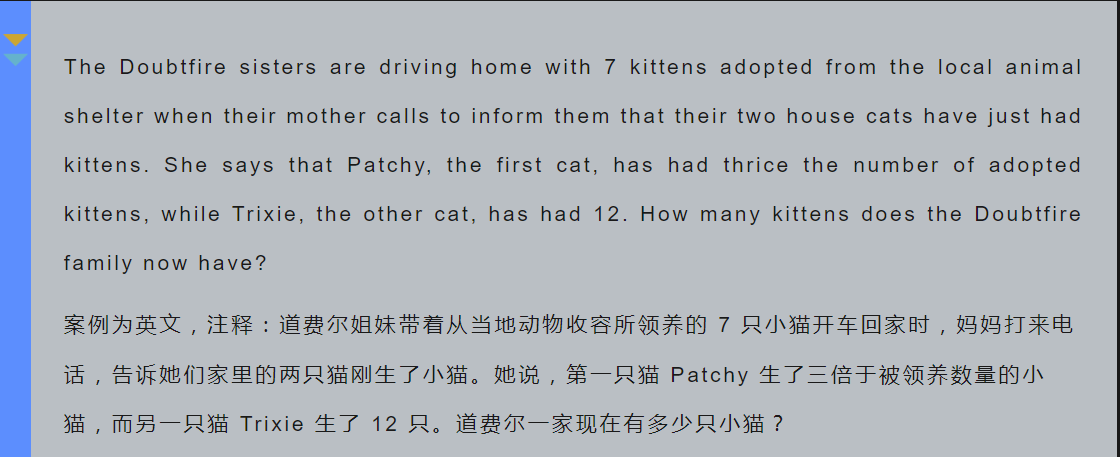

再举一个例子:

02

天工的解题思路如下:

天工大模型最终的答案是:道费尔家现在有 40 只小猫。

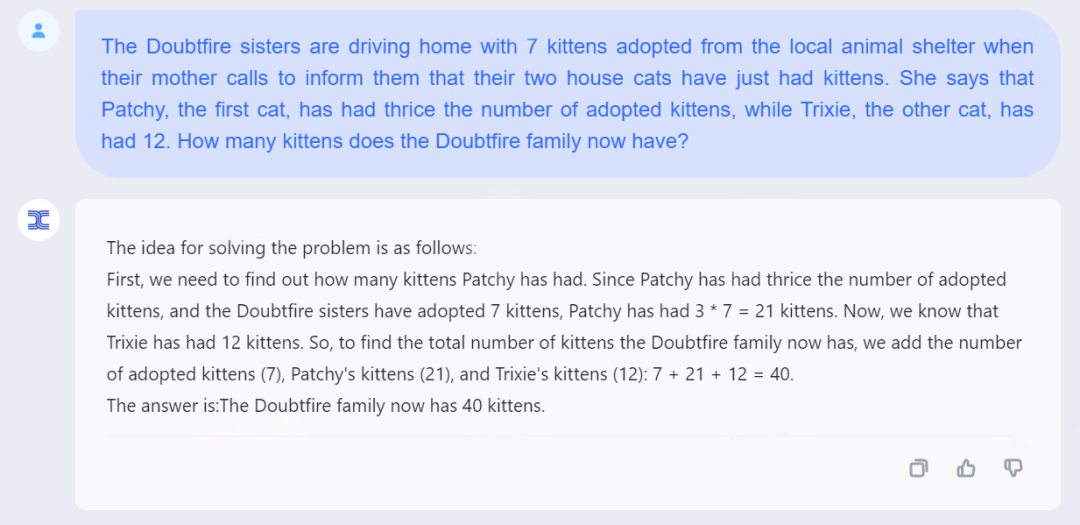

GPT-3.5的解题思路如下:

GPT-3.5的答案为:道费尔一家现在一共有 33 只小猫。

这一次GPT-3.5又给出了错误的回答。

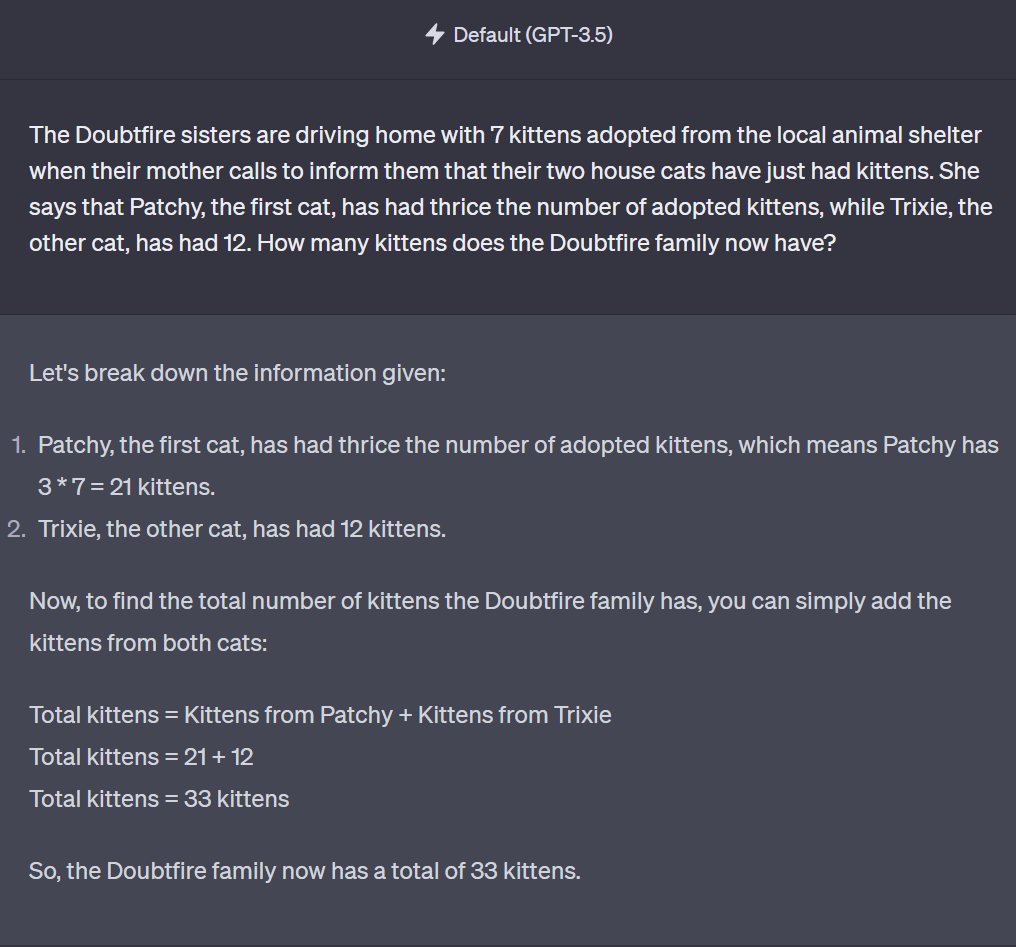

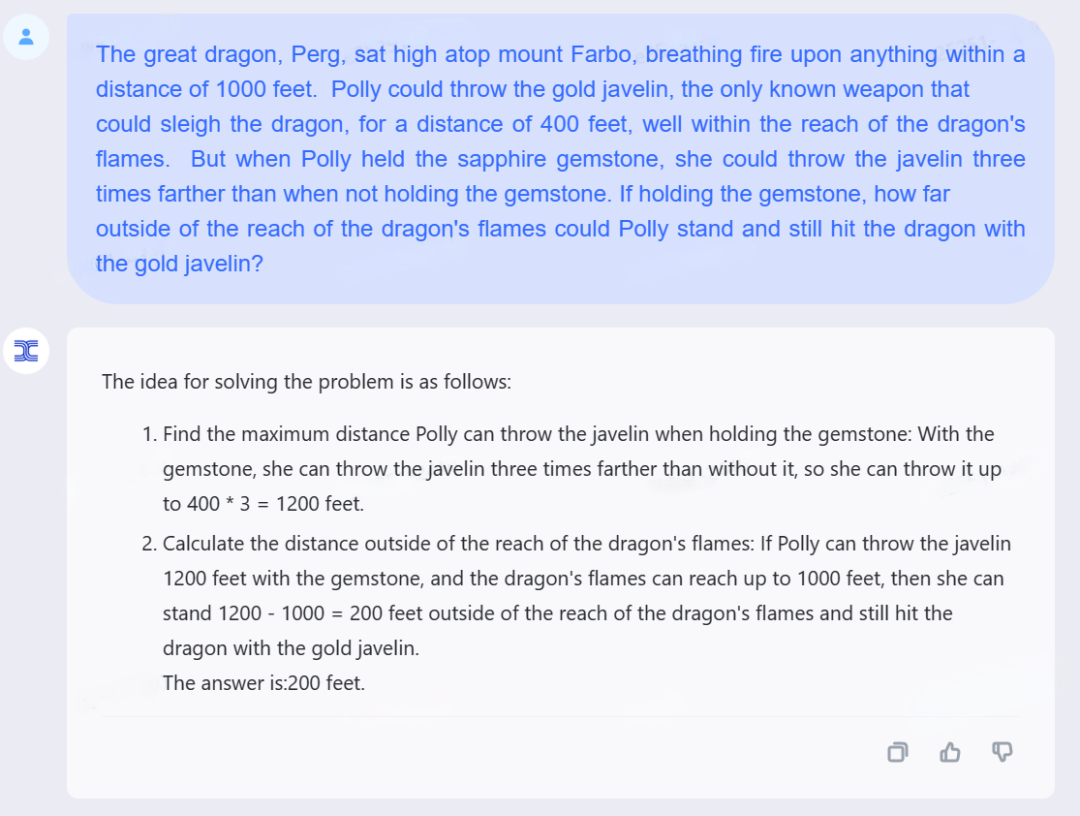

从上述案例能看出,天工大模型不仅解题正确率高,而且解题思路也比较简单、清晰,以下案例更能直观地感受到这一点:

03

天工的解题思路如下:

天工的解题思路如下:

求波莉拿着宝石时投掷标枪的最大距离:拿着宝石时,她能比不拿宝石时把标枪投出三倍远,所以她能把标枪投出 400 * 3 = 1200 英尺。

计算龙焰覆盖范围外的距离:如果波莉带着宝石可以把标枪投掷 1200 英尺,而龙的火焰可以达到 1000 英尺,那么她可以站在龙的火焰射程之外 1200 - 1000 = 200 英尺的地方,仍然可以用金标枪击中龙。

答案:200 英尺。

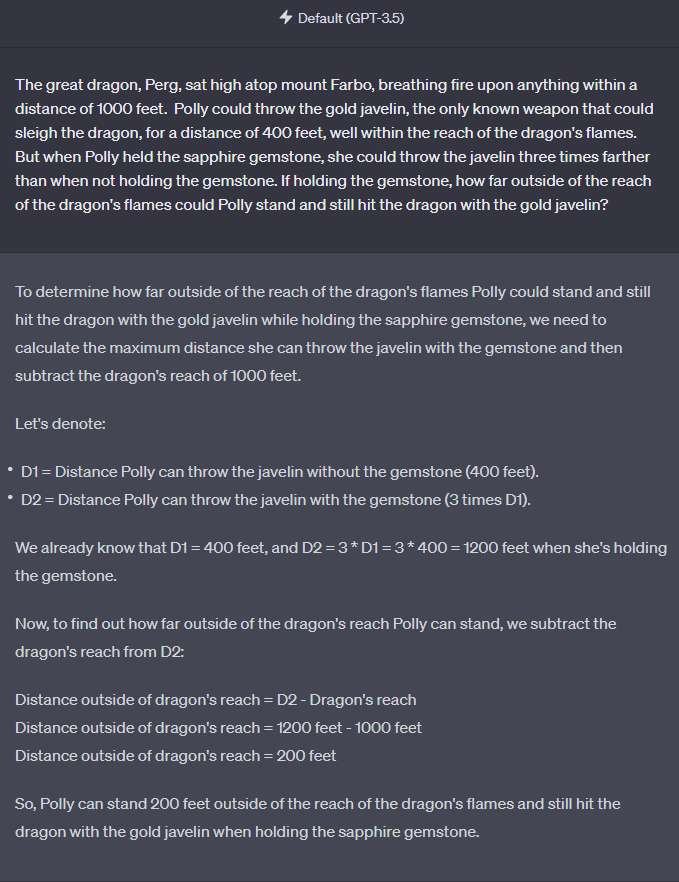

而GPT-3.5的解题思路则比较复杂:

要确定波莉在拿着蓝宝石的同时,还能站在龙的火焰射程之外多远的地方用金标枪击中龙,我们需要计算她带着宝石投掷标枪的最大距离,再减去龙的射程 1000 英尺。

D1 = 波莉在没有宝石的情况下投掷标枪的距离(400 英尺)。

D2 = 波莉使用宝石投掷标枪的距离(D1 的 3 倍)。

我们已经知道 D1 = 400 英尺,当她拿着宝石时,D2 = 3 * D1 = 3 * 400 = 1200 英尺。

现在,要想知道波莉能站在巨龙够不着的地方多远,我们就用 D2 减去巨龙够得着的地方:

龙伸手可及范围外的距离 = D2 - 龙的伸手可及范围

龙伸手可及范围外的距离 = 1200 英尺 - 1000 英尺

龙触及范围外的距离 = 200 英尺

因此,波莉可以站在巨龙火焰射程之外 200 英尺的地方,并且在手持蓝宝石时仍能用黄金标枪击中巨龙。

答案:200 英尺。

与天工相比,GPT-3.5不仅解题步骤较多,而且逻辑比较绕。

目前天工大模型仍属于内测阶段,以上评测暂未整合到天工AI搜索和天工AI助手,后续会将最好的基座部署上线,供用户体验。我们将持续打磨天工大模型的技术实力,后续全面提升旗下AI业务矩阵的智能化水平,为用户及企业的提质增效提供强大助力。